中部大学工学部情報工学科 卒業論文

距離情報を用いた回帰分析による人体姿勢推定

縣 禎輝

2011 年 3 月

指導教授 藤吉弘亘

A Graduation Thesis of College of Engineering, Chubu University

Pose Estimation by Regression Analysis with Depth Information

Yoshiki Agata

はじめに

近年,人体の姿勢・動作認識に関する研究が盛んに行われている.画像処理における 人体の姿勢や動作認識は,ジェスチャ等の動作を入力としたインターフェースの構築,ロ ボットの運動制御,CGアニメーションや監視システムなど多くの分野で応用が期待され ている.一般的な姿勢推定の手法は,モデルフィッティングの手法[2]と学習ベースの手

法[3][4]に大別できる.モデルフィッティングの手法は,推定画像と姿勢モデルとのフィッ

ティングを行うことで姿勢を推定する.フィッティングにより高精度な推定が期待できる が,フィッティングには処理コストが高くなるという問題点がある.これに対し,学習ベー スの手法は,事前に推定したい姿勢を学習しておくことで,学習後は高速な処理が可能で ある.しかし,学習に含まれない姿勢に対して精度が低下するという問題がある.また,

従来の学習ベースの手法では,既存のデータベースを用いて学習用データベースを作成す るため,既存のデータベースに存在しない姿勢は推定できないという問題がある.この問 題に対し,本手法では独自に作成した3次元人体モデルを用いて姿勢サンプルを作成する ことで解決する.使用する3次元人体モデルにより,推定したい姿勢に合わせてサンプル を生成することができるため,多様な姿勢の推定が可能となる.

学習手法には,線形分析法の1つである回帰分析を用いる.大西らによる姿勢推定法 [1]では,画像から抽出したHOG特徴量と関節パラメータを回帰分析により対応付けるこ とで姿勢推定を実現している.しかし,HOG特徴量のみを用いると人物の形状は精度よ く捉えることができるが,身体パーツの前後関係を捉えることが困難な場合がある.そこ で本手法では,距離情報を特徴量として用いることでこの問題を解決する.距離情報の取 得には,赤外光の反射時間を計測す ることで,単眼で距離情報が取得できるTOF(Time

Of Flight)カメラを用いる.本手法では,距離情報を利用する特徴量として距離差分特徴

量を提案する.距離差分特徴量は,2つのセル領域から得られる平均距離の差分値による 特徴量である.提案する特徴量を姿勢推定に用いることで,より正確な推定が可能であ

3 4 手法の有効性を示す.

目 次

第1章 TOFカメラ 1

1.1 TOFカメラのSDK . . . . 4

1.2 距離画像の生成とカラーリング . . . . 4

1.3 距離情報のノイズ除去 . . . . 6

1.4 実環境下における撮影環境 . . . . 7

第2章 姿勢推定 9 2.1 姿勢推定の従来法 . . . . 9

2.2 回帰分析を用いた姿勢推定 . . . . 10

2.3 姿勢推定及び人検出に用いられる特徴量 . . . . 10

2.3.1 Histograms of oriented gradients(HOG)特徴量 . . . . 10

2.3.2 距離ヒストグラム特徴量 . . . . 12

第3章 距離情報からの回帰分析による人体姿勢推定 13 3.1 3次元人体モデル . . . . 14

3.1.1 3次元人体モデルの概要 . . . . 14

3.1.2 Poserの人モデル . . . . 14

3.1.3 openGLによる人モデルの復元 . . . . 15

3.1.4 3次元人体モデルを用いた学習データの作成 . . . . 18

3.2 距離差分特徴量 . . . . 21

3.2.1 距離画像のセル分割と組み合わせ . . . . 22

3.3 回帰分析による関節パラメータと特徴量の対応付け . . . . 23

第4章 評価実験 25

4.2.1 . . . . 27

4.3 特徴量毎の精度比較 . . . . 29

4.3.1 実験概要 . . . . 29

4.3.2 実験結果 . . . . 29

4.3.3 姿勢推定結果 . . . . 30

おわりに 35

謝 辞 37

参考文献 39

図 目 次

1.1 TOFカメラ(SR-4000)の概要 . . . . 2

1.2 TOFカメラの応用先 . . . . 3

1.3 V=1.0におけるHSV色空間 . . . . 5

1.4 HSV空間による色付け例 . . . . 5

1.5 メディアンフィルタによる距離情報の変化 . . . . 6

1.6 距離情報のノイズ除去 . . . . 7

1.7 撮影環境 . . . . 7

2.1 HOG特徴量 . . . . 11

2.2 距離ヒストグラム特徴量 . . . . 12

3.1 提案手法の流れ . . . . 13

3.2 生成モデル . . . . 14

3.3 Poserの人モデル例 . . . . 15

3.4 人モデルの階層構造 . . . . 16

3.5 カメラパラメータによる見えの変化 . . . . 17

3.6 人の形状に影響するパラメータとそれによる見えの変化. . . . 17

3.7 3次元人体モデルの撮影環境 . . . . 18

3.8 3次元人体モデルによる姿勢サンプルの生成例(姿勢毎に距離情報と関節 パラメータを取得) . . . . 19

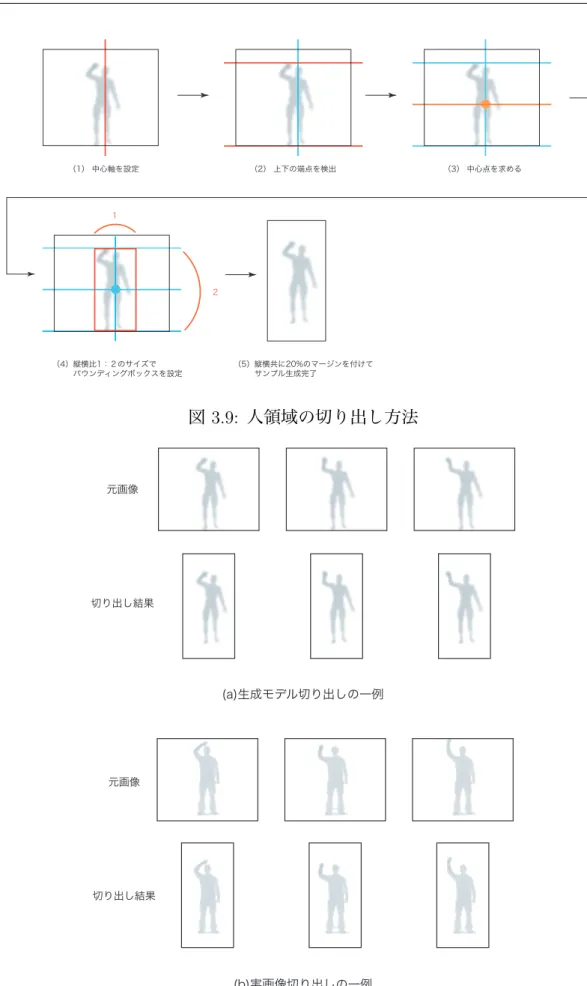

3.9 人領域の切り出し方法 . . . . 20

3.10 切り出し例 . . . . 20

3.11 従来の特徴量では推定が困難な一例 . . . . 21

3.12 距離差分特徴量 . . . . 21

4.1 評価方法 . . . . 26

4.2 特徴量へのノイズ付加実験 . . . . 27

4.3 ノイズ付加量の調査実験 . . . . 28

4.4 特徴量毎の精度比較 . . . . 29

4.5 手を振る動作における特徴量毎の精度比較 . . . . 30

4.6 特徴量毎の推定結果 . . . . 31

4.7 手を振る動作の推定結果 . . . . 32

4.8 歩行動作の推定結果 . . . . 33

表 目 次

4.1 Recallの平均値 . . . . 30

第 1 章 TOF カメラ

本研究では,高精度な姿勢推定の実現のために,TOFカメラから取得できる距離情報を 利用する.TOFカメラは,カメラの周囲に付いたLEDより照射される赤外光が対象物に 反射し,カメラで観測されるまでの時間を計測することにより,物体までの距離を測定す るカメラである.図1.1に本研究で用いるmesa社の Swiss Ranger SR-4000の製品概要,

図1.2にその応用先を示す.

TOFカメラは,時間そのものを計測するのではなく,光を数10M Hz程度の正弦波で 変調して投影し,投影光と反射光との間の位相差を測定して距離に換算する.単純に1つ の位相差だけを見ると同位相を与える距離が複数生じてしまうため,複数の波長の変調波 を用いることで測距の冗長性をなくすことなども行われている.イメージセンサのすべて の素子で同時に位相差を計測する手法を用いているため,実時間で距離画像を得ることが 可能である.赤外LEDアレイを用いて変調光を照射し,特別な固体撮像素子を用いたカ メラで撮像する.この固体撮像素子の各素子では,電荷蓄積時にゲートを高速に制御する 機能があり,これを利用することで各素子でのTOFを実現する.

図 1.1: TOFカメラ(SR-4000)の概要

図 1.2: TOFカメラの応用先

1.1 TOF カメラの SDK

TOFカメラから距離情報を取得するために,TOFカメラのSDK(Software Development Kit)を用いる.SDKとは,アプリケーションソフトの開発をする際に必要となる,ライ ブラリ,各種サンプル,ツール,ドキュメントなどで構成されたソフトウェア開発者向け のキットのことである.プログラム上でTOFカメラの距離情報を扱う際,SDKに含まれ るAPI(Application Program Interface)を用いて,取得される距離情報の操作を行う必要 がある.以下に,SDKに含まれるAPIを示す.

• typedef struct CMesaDevice SRCAM – SR-4000用のカメラ構造体

• int SR OpenUSB( SRCAM srCam, unsigned int serialNumber ) – SR-4000との接続を行う

• int SR Close( SRCAM srCam ) – SR-4000との切断を行う

• int SR Acquire( SRCAM srCam ) – カメラから情報を取得する

• unsigned int SR GetCols(SRCAM srCam),unsigned int SR GetRows(SRCAM srCam) – 画像のサイズの取得(横幅,縦幅)

• int SR CoordTrfFlt( SRCAM srCam, float* x, float* y, float* z, int pitchX, int pitchY, int pitchZ )

– 出力距離データをカーテシアン座標(x,y,z座標)へ変換し,取得

1.2 距離画像の生成とカラーリング

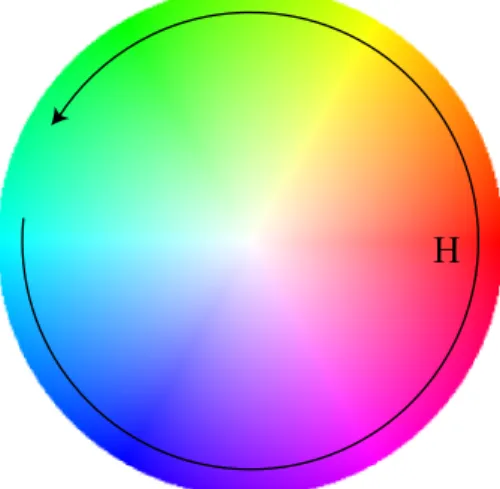

TOFカメラから得られる距離情報は,各画素における0mから5.0mまでの距離情報で ある.この距離情報と濃淡を対応付けすることにより,距離情報に基づく距離画像を生成 することが可能となる.距離情報は世界座標系で表わされるため,画像座標系に変換し奥 行き(z軸)情報を0から255 までの整数に正規化することにより輝度値に変換する.HSV 色空間を図1.3,実環境で撮影したデータをHSVにより色付けした例を図1.4に示す.

1.2. 距離画像の生成とカラーリング

図 1.3: V=1.0におけるHSV色空間

図 1.4: HSV空間による色付け例

1.3 距離情報のノイズ除去

TOFカメラは,照射された赤外光が物体に反射して戻ってくる時間を計測するため,物 体の反射率の違いによってノイズが発生する.SR-4000では,このようなスパイクノイズ を除去するために,メディアンフィルタとオートイルミネーション機能が備えられてお り,これらを用いることによりノイズ除去を行うことが可能である.

メディアンフィルタ メディアンフィルタは,ある領域内の中央値を出力とするフィルタ であり,スパイクノイズなどの急激な変化の除去に有効である.ただし,SR-4000に備え られているメディアンフィルタは,フィルタリングの過程で距離情報を歪める特製を持っ ている.図1.5[1]は,TOFカメラからほぼ垂直に床平面を撮影した結果である.図1.5[2]

はそれに対してメディアンフィルタによるノイズ除去処理を加えたものである.2つの結 果から座標点が歪んでいることが確認できる.このような理由から,本研究ではSR-4000 のメディアンフィルタ機能は使用しない.

オートイルミネーション オートイルミネーションは,物体の距離の違いによる反射時間 の違いをどの程度距離情報に反映させるかを自動で決定するものである.オートイルミ ネーションを行うことにより,撮影している物体の距離に適した反射時間を用いるため,

ノイズの発生を抑制できる.スパイクノイズなどの急激な変化の除去に有効なフィルタで ある.オートイルミネーションはメディアンフィルタと違い距離情報を歪めないため,本 研究ではこの機能を有効な状態で撮影を行う.

図 1.5: メディアンフィルタによる距離情報の変化

1.4. 実環境下における撮影環境

図 1.6: 距離情報のノイズ除去

1.4 実環境下における撮影環境

実際に姿勢推定を行う際の撮影環境は,TOFカメラの撮影可能距離により5mまでと 制限される.しかし,家庭用ゲームなどでの実利用を考えたとき,カメラはテレビの前に 置かれることが想定できる.そのため,今回は,推定対象人物がTOFカメラから直線上 の4〜5m地点にいることを想定する.撮影環境を図1.7に示す.

図 1.7: 撮影環境

第 2 章 姿勢推定

姿勢推定とは,画像または動画中に存在する物体を検出し,その物体がどのような姿勢な のかを推定することである.本研究では,人体の姿勢推定を目的とする.

2.1 姿勢推定の従来法

姿勢推定には,多様な手法が存在するが大別すると3つのアプローチに分類できる.1 つ目は学習用データを大量に学習させておき,入力画像を識別する学習ベースの手法であ る.学習ベースの手法は,学習されていない未知のデータに対して精度が低下する傾向が あるが,一度学習を行うとその後の識別の処理時間が早いというメリットがある.2つ目 は,人体モデルにより姿勢を作成し,作成された姿勢と実画像とのマッチングにより姿勢 を推定する手法である.モデルベースの手法は,未知のデータに対してもモデルとのマッ チングを行うことにより高精度な推定が期待できるが,一般的に処理時間が多く掛かる ことが報告されている.3つ目は,推定対象人物の関節にマーカを付け,複数台のカメラ により人物を撮影することで,関節の空間座標を取得するモーションキャプチャである.

モーションキャプチャは,詳細なパラメータを得ることが可能だが,特殊な撮影環境が必 要であり高コストである.本研究では,実用的なリアルタイムの姿勢推定を目標に学習 ベースの手法を用いた姿勢推定手法を提案する.

2.2 回帰分析を用いた姿勢推定

学習ベースの姿勢推定手法に,大西らの回帰分析を用いた姿勢推定手法[1],[5]がある.

この手法では,アピアランスに基づく特徴として,物体の形状を表すことが可能なHOG 特徴を用いる.この特徴量を用いることにより,ノイズがある条件下で服装,向きによら ず特徴を安定して抽出できる.しかし,通常のHOG特徴は前景と背景の両方の特徴量を 求めるため,人物以外の背景領域にも多くの特徴次元をもつことになる.そこで,HOG 特徴のブロック領域ごとに主成分分析をすることにより,背景領域の特徴次元のみを大き く削減できる.このようにして得られた特徴を,3次元人体モデルの特徴ベクトルに射影 することで姿勢を推定する.しかし,大西らの手法では,HOG特徴量を用いるため,身 体パーツの前後関係を捉えることが困難な場合がある.そこで,本研究ではTOFカメラ から取得した距離情報を用いることで,より正確な推定を可能にすることを提案する.

2.3 姿勢推定及び人検出に用いられる特徴量

姿勢推定に用いられる特徴量として,前述したHOG特徴量がある.輝度勾配情報に基 づいた,この特徴量は,人の形状を捉えることに優れており,姿勢推定及び人検出によく 用いられている.また,従来の距離情報を用いた特徴量として,距離ヒストグラム特徴量 が[7]がある.この特徴量は.距離画像から分割した矩形領域の関係性を捉えることがで きる特徴量のため,姿勢推定に対して応用できると考えられる.以下に,提案する特徴量 との比較のために,HOG特徴量と距離ヒストグラム特徴量について述べる.

2.3.1 Histograms of oriented gradients(HOG) 特徴量

文献[1]では,HOG特徴量を用いて,姿勢推定を実現している.HOG特徴量[6]は,局 所領域における輝度勾配をヒストグラム化した特徴量であり,物体の形状を捉えることが 可能である(図2.1の(b)).この特徴量は,近接画素の勾配を局所領域ごとにヒストグラ ム化するため,照明の影響を受けにくく,局所的な幾何学変化に頑健という特徴がある.

HOG特徴量を算出するためには,はじめに入力画像をあらかじめ定義したパッチサイ ズにダウンサンプリングし,各ピクセルの輝度I(u, v)から勾配強度m(u, v)と勾配方向

2.3. 姿勢推定及び人検出に用いられる特徴量

する.

m(u, v) =

√

Iu(u, v)2+Iv(u, v)2 (2.1) θ(u, v) = tan−1 Iv(u, v)

Iu(u, v) (2.2)

Iu(u, v) =I(u+ 1, v)−I(u−1, v) Iv(u, v) =I(u, v+ 1)−I(u, v−1)

(2.3)

図 2.1: HOG特徴量

次に,算出した勾配強度mと勾配方向θを用いて,式(2.4)よりセル領域c(p×pピク セル)における量子化勾配方向θ0の勾配強度の和を算出する.

vc(θ0) =∑

u

∑

v

m(u, v)δ[θ0, θ(u, v)] (2.4)

δはKroneckerのデルタ関数であり,勾配方向θが量子化勾配方向θ0と同じヒストグラ ムの要素である場合は1を返す.式(2.4)より算出した量子化勾配方向θ0における勾配強 度の和の集合を,N方向の勾配方向ヒストグラムVc ={vc(1), vc(2),· · ·, vc(N)}とする(図 2.1の(d)).この時,算出される勾配方向はθは0◦−360◦となるが,勾配方向の向きを考 慮しないため,0◦−180◦とする.本研究では,セル領域cを8×8ピクセル,量子化勾配 方向θ0を8方向とする.

最後に,式(2.5)を用いてブロック領域(q×qセル)ごとにヒストグラムを正規化し,特 徴量を抽出する.本研究では,ブロック領域を2×2セルとする.

vc0(n) = vc(n)

vu (= 1) (2.5)

ブロック領域は,1セルごとに正規化対象のセル領域が重なるように移動しながら正規 化する.正規化後の勾配方向ヒストグラムVc0は,Vc0 ={vc0(1), vc0(2),· · ·, v0c(B×N)}とな る.ここで,Bはブロック領域に含まれるセル領域の数である.

2.3.2 距離ヒストグラム特徴量

距離ヒストグラム特徴量[7]は,局所領域から得られる距離ヒストグラムの類似度によ る特徴量である.距離ヒストグラム特徴量は,図2.2に示すように,セル分割された入力 画像から距離ヒストグラムを算出する2つの矩形領域を選択する.選択された2つの矩形 領域から距離情報に基づき距離ヒストグラムを算出する2つの矩形領域から距離ヒストグ ラムの類似度を式(2.6)のBhattacharyya距離により求める.

S=

∑m u=1

√puqu (2.6)

類似度の算出を全ての矩形領域から算出することで特徴量としたものが距離ヒストグラム 特徴量である.矩形領域の組み合わせは,矩形領域のサイズを可変させることで増やすこ とができる.人検出では,人の形状の表現能力を上げるため,特徴量数が膨大になる.し かし,回帰分析を用いた本手法では,特徴量数が膨大になると分析時間が増加するため,

矩形領域の組み合わせは最小セル間のみに設定する.また,人の位置ずれを吸収するため にセルサイズは16×16に設定する.

図 2.2: 距離ヒストグラム特徴量

第 3 章 距離情報からの回帰分析による人 体姿勢推定

本章では,まず,学習データベースを作成する3次元人体モデルについて述べ,学習デー タの作成例を示す.そして,本研究で新しく提案する距離差分特徴量について述べた後,

回帰分析による関節パラメータと距離差分特徴量の対応付けについて説明する.提案手法 では,回帰分析により人体モデルから得られる関節パラメータと2つの領域間の差分によ る特徴量を対応付けることで変換行列を算出する.算出した変換行列にTOFカメラから 得られた距離特徴量を入力することで人物の姿勢を推定する.図3.1に提案手法の流れを 示す.

3.1 3 次元人体モデル

本研究では,3次元人体モデルから学習データを生成して学習データベースを作成する.

最初に3次元人体モデルの概要を示し,生成した学習データの例を示す.

3.1.1 3 次元人体モデルの概要

本研究で用いる3次元人体モデルは,3Dキャラクタ作成ソフトウェアPoserの人モデ ルに基づき作成する.3次元人体モデルを図3.2に示す.この3次元人体モデルを用いて,

学習データベースを生成する.

図 3.2: 生成モデル

3.1.2 Poser の人モデル

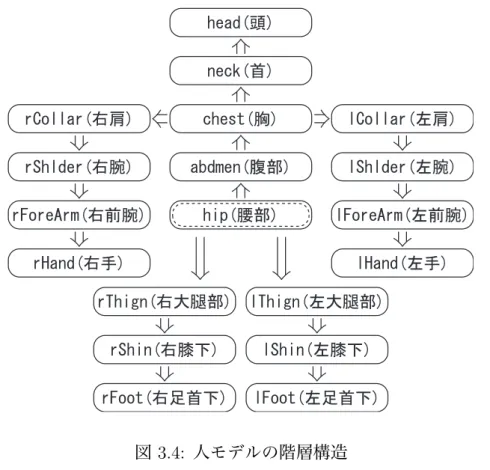

本研究で用いる人体モデルは,3Dキャラクタ作成ソフトウェアPoserから作成したパ ラメータを入力することができるPoserにより姿勢を作成することで容易に多様な学習サ ンプルを生成することができる.図3.3に本研究で使用した人モデル例を示す.

この人モデルは様々な情報が含まれており,その中でも生成モデルに必要となる人モデ ルの形状データ,モデルのパーツの階層構造,動作データを抽出することで人体モデルに 利用する.

3.1. 3次元人体モデル

図 3.3: Poserの人モデル例

関節角度が数フレーム分与えられており,各パーツにこの値を与えれば人モデルをPoser と同様に動かすことが出来る.

3.1.3 openGL による人モデルの復元

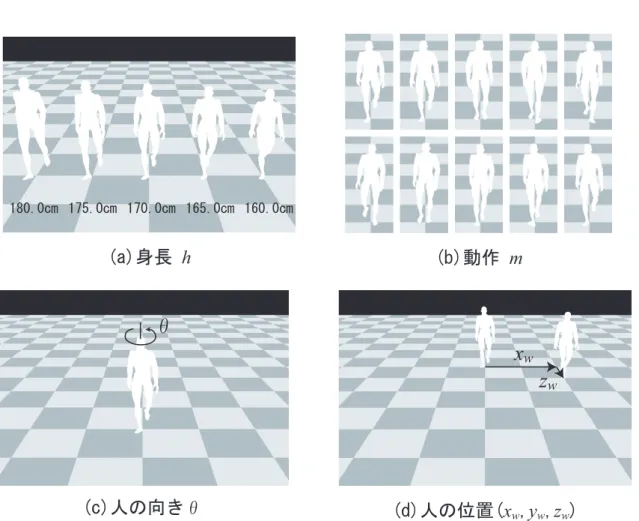

Poserから抽出したデータをopenGLで復元して人体モデルを作成する.このモデルに

対して以下に示す様々なパラメータを与えることで,様々な姿勢のデータを生成すること が出来る.

• カメラパラメータ

画角α ,アスペクト比aspect ,カメラ位置xc,yc,zc ,カメラ角度φx,φy,φz

• 人体形状パラメータ

身長h,動作m ,人の向きθ ,人の位置xw,yw,zw

• テクスチャ

背景のテクスチャTbg ,人の中身のテクスチャTin

図 3.4: 人モデルの階層構造

お,カメラの位置zc は仮想空間の床の中心からの距離となる.図3.5 にカメラパラメー タを変化させたときの生成モデルを示す.

人体形状パラメータを入力することで人体シルエットの見えが各パラメータ名に対応し て変化する.図3.6 に人体形状パラメータをそれぞれ変化させたときの生成モデルを示す.

3.1. 3次元人体モデル

図 3.5: カメラパラメータによる見えの変化

図 3.6: 人の形状に影響するパラメータとそれによる見えの変化

3.1.4 3 次元人体モデルを用いた学習データの作成

3次元人体モデルを用いて,学習データを作成する.学習データは関節パラメータと距 離情報を必要とする.本研究で用いる3次元人体モデルは,姿勢を生成する際にその姿勢 に対応する関節パラメータとカメラまでの距離情報をdepth mapとして出力することが できる.今回作成する学習サンプルは実環境の姿勢推定に利用するため,カメラの位置も 実環境に合わせる必要がある.カメラとモデルの撮影環境を図3.7に示す.

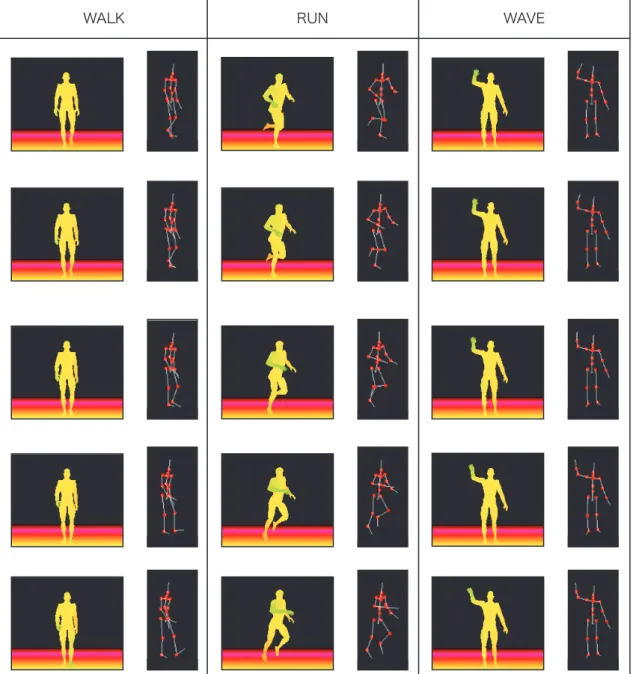

3次元人体モデルは,19の関節より構成されており,1つの関節に(x, y, z)の3パラメー タを持つ.1つの姿勢は19×3 = 57パラメータにより表現することができる.また,各 姿勢からはモデルからカメラ間の距離情報を取得することができる.撮影環境を図3.7の ように設定し,3次元人体モデルより取得した学習データ例を図3.8に示す.

モデルより取得した疑似距離画像及びTOFカメラより得た距離画像は,特徴抽出する 際に人領域を切り出すことで,特徴次元数を減らすことができる.特徴次元数は,処理時 間に大きく影響するため,低次元であればあるほど処理が早くなる.また,回帰分析に用 いる学習データの特徴次元と,入力距離画像の特徴次元は同じでなければならないため,

距離画像は一定サイズにリサイズする必要がある.人領域の切り出しとリサイズの処理過 程を図3.9,切り出し例を図3.10に示す.

図 3.7: 3次元人体モデルの撮影環境

3.1. 3次元人体モデル

図3.8: 3次元人体モデルによる姿勢サンプルの生成例(姿勢毎に距離情報と関節パラメー

タを取得)

図 3.9: 人領域の切り出し方法

3.2. 距離差分特徴量

3.2 距離差分特徴量

本研究では,距離画像から算出する特徴量として,距離差分特徴量を提案する.距離差 分特徴量は,図3.12に示すように,入力距離画像をセル分割し2つのセルを選択する.選 択されたセルから,セル内の平均距離の差分値を算出する.これをセル全ての組み合わせ に対して算出した値を距離差分特徴量とする.特徴次元数は,32セルとした場合,32C2 となり496次元の特徴量が算出される.従来の輝度勾配に基づく特徴量では,図3.11の (a),(b)に示すような,カメラに対して横に人が歩いていく場合.左右の腕と脚の識別が 困難となる.しかし,距離差分特徴量は,距離情報を用いてセル領域の前後関係を捉える ことで,正確な姿勢を推定することが可能であると考えられる.

図 3.11: 従来の特徴量では推定が困難な一例

図 3.12: 距離差分特徴量

3.2.1 距離画像のセル分割と組み合わせ

距離画像から距離差分特徴量を抽出するため,距離画像をセル分割する必要がある.セ ルサイズは小さくすると特徴量数が多くなり,物体に対する表現能力は上がるが,多少の 位置ずれに対しても大きく特徴量が変わる場合がある.そのため,今回は実験的にセルサ

イズは16×16[pixel]に設定した.分割したセルから2つの組み合わせを選択し,セル内

の平均距離の差分を算出する.これを全セルの全組み合わせに対して行うことで距離差分 特徴量を得る.セル分割過程を図3.13,セルの組み合わせ例を図3.14に示す.

図 3.13: セル領域の分割

図 3.14: セル領域の組み合わせ例

3.3. 回帰分析による関節パラメータと特徴量の対応付け

3.3 回帰分析による関節パラメータと特徴量の対応付け

回帰分析を用いて特徴量と関節パラメータを対応付ける.496次元からなる特徴量を x0 = (x1, x2, ..., x496),57次元からなる関節パラメータをy0 = (y1, y2, ..., y57)とすると,

学習サンプル数がn枚の場合,特徴量を496×n行列のX = (x01,x02, ...,x0n)T,関節パラ メータを57×n行列のY = (y10,y02, ...,y0n)T と表す.推定問題は以下のように表せる.本 手法では,回帰分析により特徴ベクトルXと関節パラメータY の関係を式(3.1)により 分析し496×57行列の変換行列A0を算出する.

A0 = arg min

A ||AX−Y||2 (3.1)

算出した変換行列A0を用いることで,TOFカメラの距離画像から求めた特徴量X0を入 力して,関節パラメータY0を推定することができる.関節パラメータY0の推定式を式

(3.2)に示す.εは残差ベクトルであり,学習サンプルを入力した際の真値との平均誤差で

ある.

Y0 =A0X0+ε (3.2)

第 4 章 評価実験

評価実験により,距離差分特徴量の有効性を示す.評価は,従来の姿勢推定及び人検出に 用いられる特徴量との比較を行う.まず,汎用的な学習データを作成する際の実験につい て説明した後,特徴量毎の比較結果を示す.

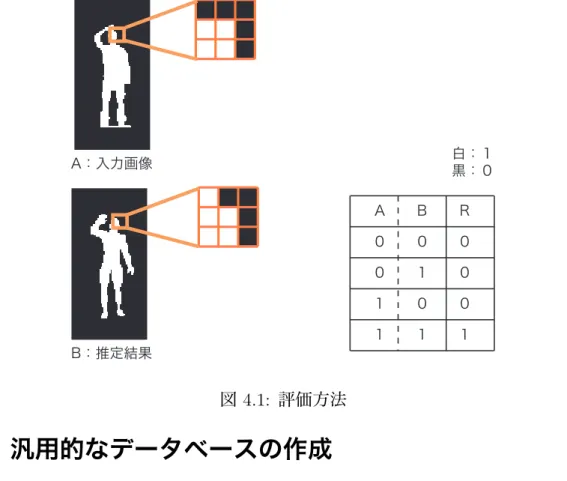

4.1 評価方法

推定精度の評価方法は,入力データと推定結果との尤度をRecall(再現率)により表現す る.画像中の人領域を1,背景を0とすると,入力画像と推定画像の人領域が一致したピ クセル数をtrue positive,推定画像の人領域の総ピクセル数をtotal pixelと表す.図4.1 に示すように,入力画像Aと推定結果画像Bが共に人領域となるtrue positiveをtotal pixelで割ることで式4.1によりRecallを算出する.Recallの値が1に近づくほど尤度が 高く精度が良いことになる.

Recall= true positive

total pixel (4.1)

図 4.1: 評価方法

4.2 汎用的なデータベースの作成

学習データベースを作成するの問題点として,本研究で用いる人体モデルは体型を変 化させることができないため,全てのデータが同じ体型の人物になることが上げられる.

従来の学習ベースの姿勢推定や人検出では,様々な服装や体型の人物を学習させるため,

学習結果に汎用性があると考えられる.そのため,同じ体型の人物のみで構成されたデー タベースでは,汎用性がなくなり違う体型の人物の推定精度が低下することが懸念され る.そこで,本研究では,データベースを作成する際に特徴量に対しランダムにノイズを 加えることで,擬似的にデータベースにばらつきを持たせることを考慮する.同じ体型の 人物から得られる特徴量にノイズを加え,ばらつきを持たせることで違う体型の人物か ら得られる異なる特徴量を吸収することができると考えられる.また,本研究で用いる線 形回帰分析は,データベースにばらつきがない場合,学習サンプルに対し誤差がない高精 度な推定が可能なため,よりデータベースに依存する学習法といえる.以上の考察から,

データベースにばらつきを持たせることが有効だと考え,特徴量にノイズを加えた場合と 加えない場合の精度を比較した.ノイズは特徴量の次元数の10[%]を付加した.距離差分 特徴量,距離ヒストグラム特徴,HOG特徴量における実験結果を図4.2に示す.

4.2. 汎用的なデータベースの作成

図 4.2: 特徴量へのノイズ付加実験

実験結果より,ノイズを加えることで,どの特徴量を用いても精度が向上することがわ かる.この結果より,ノイズを加えることでデータベースに汎用性を持たせることが確認 できたため,データベースへのノイズ付加の有効性を示すことができた.

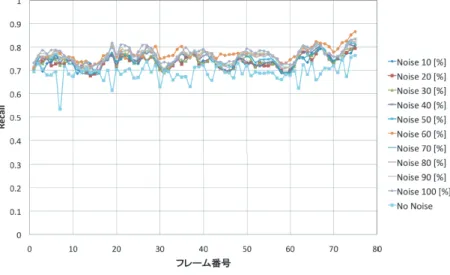

4.2.1 ノイズ付加量による精度比較

実験結果より,ノイズを付加することで精度が向上することが確認できた.そのため,

最適なノイズ付加量を調査することで,更に精度が向上することが期待できる.ノイズ

HOG特徴量の実験結果を図4.3に示す.実験結果より,ノイズ付加量の変化による推定 精度の大きな変化はないことがわかる.今回は,Recallの平均が一番高い60[%]の付加量 を採用した.

図 4.3: ノイズ付加量の調査実験

4.3. 特徴量毎の精度比較

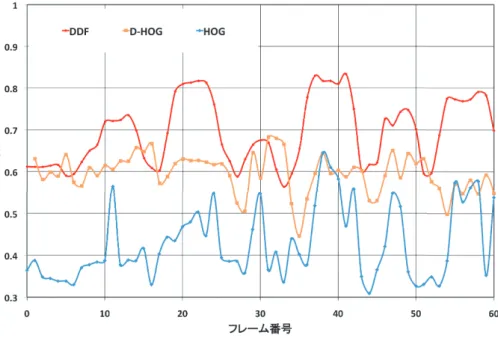

4.3 特徴量毎の精度比較

従来の姿勢推定に用いられる特徴量と距離差分特徴量との比較を行うことで提案手法 の有効性を示す.

4.3.1 実験概要

評価には,手を振る動作と歩行動作を対象とし,各動作に学習用サンプル100枚,評 価用サンプル60枚を用いる.実験に用いる特徴量は,距離画像から求めたHOG特徴量

(D-HOG),シルエット画像から求めたHOG特徴量(HOG),距離差分特徴量(DDF)の3

つを比較する.

4.3.2 実験結果

図4.4に,手を振る動作,図4.5に,歩行動作における各特徴量に対するRecallを示す.

実験結果より,距離差分特徴量はRecallが最も高いことがわかる.Recallの平均値を表 4.1に示す.

図 4.4: 特徴量毎の精度比較

図 4.5: 手を振る動作における特徴量毎の精度比較 表 4.1: Recallの平均値

DDF D-HOG HOG WAVE 0.76 0.67 0.63 WALK 0.70 0.60 0.53

4.3.3 姿勢推定結果

各特徴量における姿勢推定例を図4.6に示す.HOGでは,左右の腕と脚を識別するこ とは困難であり,左右反対に誤って推定されている.また,D-HOGでは,距離画像によ る内部エッジにより左右の腕と脚は識別できているが,奥行きの情報がないため,肩が不 自然に開いた姿勢となった.距離差分特徴量では,距離情報を効果的に捉えるため,左右 の腕と脚を正確に推定できていることがわかる.

実験結果より,距離差分特徴量の有効性を示すことができた.距離差分特徴量を用いた 姿勢推定の他の例を図4.7,4.8に示す.

4.3. 特徴量毎の精度比較

図 4.6: 特徴量毎の推定結果

4.3. 特徴量毎の精度比較

おわりに

本論文では,距離差分特徴量を用いて,セル領域の前後関係を捉える高精度な姿勢推定手 法を提案した.距離差分特徴量を用いることで,手を振る動作のrecallの平均値がHOGよ り0.13,D-HOGより0.09優れていることを確認した.また,歩行動作においては,HOG

より0.17,D-HOGより0.1優れていることを確認した.今後は,未学習の姿勢における

推定を検討する.

謝 辞

本研究を行うにあたり,終始懇切なご指導をいただきました中部大学工学部 藤吉弘亘准 教授に謹んで深謝します.次に本研究を進めるにあたり,有意義な御助言,ご指導頂いた 中部大学大学院工学研究科情報工学専攻 池村翔氏,松島千佳氏,安藤寛哲氏に心から厚 くお礼を申し上げます.最後に,本研究においてアドバイスや相談等に協力していただい た藤吉研究室の皆様に感謝いたします.

参考文献

[1] 大西克則,博格利,滝口哲也,有木康雄, HOG特徴に基づく単眼画像からの人体3次 元姿勢推定 ,MIRU2008,pp.960-965,2008.

[2] 田中秀典, 中澤篤志, 町田貴史, 竹村治雄, ”ボリュームデータの細線化とグラフマッ チングを用いた事例ベース人体姿勢推定”, MIRU2006, pp.70-77, 2006.

[3] 岡田隆三,シュテンガ ビヨン, シルエットを用いたtree-based fil- tering による人体 の姿勢推定 , MIRU2006, pp.63-69,2006.

[4] M. Andriluka, S. Roth, and B. Schiele, ”Pictorial structures revisited: People detec- tion and artic- ulated pose estimation” CVPR,pp.1014-1021,2009.

[5] 大西克則, 博格利,滝口哲也,有木康雄, 固有空間でのモデルフィッティングによる単 眼画像からの人体 3次元姿勢推定 ,MIRU2010,pp.589-594,2010-07

[6] N. Dalal and B, Triggs, Histograms of Oriented Gradients for Human Detection , IEEE Computer Vision and Pattern Recognition, pp. 886-893, 2005.

[7] 池 村 翔, 藤 吉 弘 亘,”距 離 情 報 に 基 づ く 局 所 特 徴 量 に よ る リ ア ル タ イ ム 人 検 出”

,SSII2009,,2009.

距離情報を用いた回帰分析による人体姿勢推定 縣 禎輝

(中部大学工学部情報工学科)